Поисковые роботы Яндекса и Google — это сложные программы, которые обходят все доступные страницы в Интернете для создания поискового индекса. Роботы действуют как автоматические агенты, которые осматривают каждую страницу и собирают информацию о ее содержимом, структуре и ссылках на другие страницы.

Когда роботы обнаруживают новую страницу, они проходят по всем ссылкам на этой странице и добавляют их в очередь для будущей обработки. Роботы приоритезируют индексацию страниц, исходя из различных факторов, таких как релевантность, популярность и обновление контента. Это позволяет поисковым системам предоставлять пользователю актуальные и релевантные результаты поиска.

Когда роботы проходят по ссылкам и индексируют новые страницы, они анализируют текст на странице, мета-данные, заголовки и другие элементы, чтобы понять о чем идет речь. Они также анализируют структуру страницы и ищут ключевые слова и фразы, чтобы определить ее тематику и relevanzность для поисковых запросов пользователей.

Кроме того, роботы Яндекса и Google используют различные факторы ранжирования для определения порядка, в котором появляются результаты поиска. Некоторые из этих факторов включают количество ссылок, указывающих на страницу, качество и авторитетность этих ссылок, а также соответствие страницы поисковому запросу. Эти алгоритмы постоянно обновляются и совершенствуются, чтобы улучшить качество результатов поиска.

Как работают поисковые роботы Яндекса и Google

Роботы начинают свою работу с поиска новых страниц. Они обходят все ссылки на веб-страницах и переходят по ним, индексируя каждую обнаруженную страницу. Роботы работают в автономном режиме, автоматически обнаруживая новый контент и обновляя уже проиндексированные страницы.

Одним из ключевых аспектов работы поисковых роботов является определение релевантности страницы. Они анализируют текстовое содержание страницы, заголовки, мета-теги и другие элементы страницы, чтобы понять, о чем именно она. Кроме того, роботы учитывают множество других факторов, таких как количество ссылок на страницу, ее популярность и авторитетность источника.

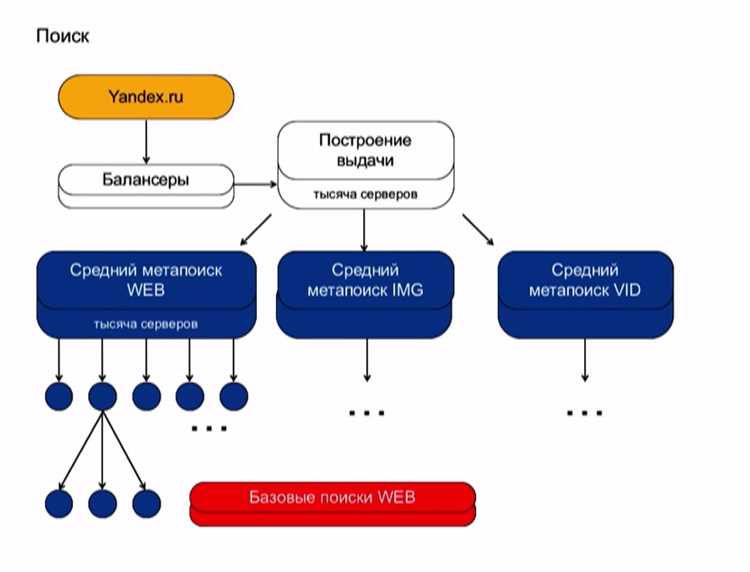

Результаты работы роботов индексируются и сохраняются в специальных базах данных, которые обновляются с определенной периодичностью. Поисковые системы, такие как Яндекс и Google, обращаются к этим базам данных и используют их для формирования результатов поиска.

Важно отметить, что Яндекс и Google имеют свои собственные критерии ранжирования и алгоритмы, которые определяют, какие страницы будут показаны пользователю в начале результатов поиска. Эти алгоритмы постоянно обновляются и улучшаются, чтобы обеспечить наиболее релевантные результаты для пользователей.

Роль поисковых роботов в работе поисковых систем

Поисковые роботы выполняют ряд важных функций. Они анализируют текст, извлекают ключевые слова и фразы, создают алгоритмы ранжирования, определяющие порядок отображения результатов поиска. Роботы также сканируют все ссылки на страницах сайтов, чтобы понять, какие сайты ведут на другие сайты. Это позволяет поисковым системам создать карту всех страниц веб-сайта и определить их взаимосвязи.

После того как поисковые роботы прошли по всем страницам сайтов, они отправляют полученные данные на серверы поисковых систем. Здесь данные обрабатываются и индексируются, что позволяет поисковым системам отображать страницы пользователю при запросе.

Индексация — это процесс присваивания каждой странице определенного значимости, исходя из ее содержимого и других факторов. Индексированные страницы записываются в специальные базы данных, где они хранятся для последующего поиска. Это позволяет поискавым системам быстро находить и отображать результаты поиска пользователю.

Принципы работы поисковых роботов Яндекса и Google

Как работает Яндекс? Поисковый робот Яндекса, известный как Яндекс.Бот, использует специальные алгоритмы и индексы, чтобы найти и проанализировать веб-страницы в Интернете. Яндекс.Бот периодически посещает страницы, следует по ссылкам и собирает информацию о содержании и структуре каждой страницы. Затем эта информация сохраняется в индексе Яндекс, который является базой данных с информацией о миллиардах веб-страниц.

Принципы работы Google:

- Алгоритмы ранжирования: Google использует сложные алгоритмы ранжирования, чтобы определить, какие страницы будут отображаться в результатах поиска и в каком порядке. Они учитывают множество факторов, включая ключевые слова, релевантность, авторитетность и популярность страницы.

- Персонализированный поиск: Google также использует информацию о предыдущих запросах и действиях пользователя, чтобы предоставить персонализированные результаты поиска. Это позволяет учесть индивидуальные предпочтения и интересы каждого пользователя.

Короче говоря, поисковые роботы Яндекса и Google являются умными программами, которые обеспечивают возможность быстрого и эффективного поиска информации в интернете. Они сохраняют огромное количество данных о миллиардах веб-страниц и используют сложные алгоритмы, чтобы предоставить наиболее релевантные результаты поиска для пользователей.

Основные факторы, влияющие на индексацию сайтов поисковыми роботами

Для того, чтобы ваш сайт был успешно проиндексирован поисковыми роботами, необходимо учесть ряд факторов, которые оказывают влияние на процесс индексации. Рассмотрим основные из них:

1. Качество контента

Контент является одним из главных факторов, влияющих на индексацию. Поисковые роботы анализируют качество и уникальность контента на странице, а также его релевантность по отношению к запросам пользователей. Чем интереснее и полезнее контент, тем больше вероятность его высокого ранжирования в результатах поиска.

2. Структура сайта

Хорошо спроектированная и логически структурированная архитектура сайта позволяет поисковым роботам эффективно обходить его страницы и находить новый контент. Для этого важно создать понятную навигацию, использовать категории и подкатегории, а также добавлять внутренние ссылки между страницами сайта.

3. Технические аспекты

Поисковые роботы оценивают также технические аспекты сайта, такие как скорость загрузки страниц, доступность для посетителей, использование метатегов и альтернативных текстов для изображений, наличие файла robots.txt и карты сайта. Важно следить за техническим состоянием сайта и регулярно проверять его на ошибки.

4. Количество и качество ссылочной массы

Ссылочная масса сайта, то есть количество внешних ссылок, указывающих на него, является одним из ключевых факторов для поисковых роботов. Однако не только количество, но и качество этих ссылок имеет значение. Более высокий авторитет и релевантность сайтов, с которых идут ссылки, позитивно сказывается на индексации и ранжировании сайта.

Итог

Для успешной индексации вашего сайта поисковыми роботами Яндекса и Google необходимо учесть множество факторов, влияющих на этот процесс. Качество контента, структура сайта, технические аспекты и качество ссылочной массы – все эти факторы играют важную роль в определении рейтинга вашего сайта. При создании и оптимизации сайта следует обратить внимание на эти аспекты и таким образом повысить шансы на успешную индексацию и улучшение позиций в выдаче поисковых систем.